9月6日,百川智能发布第二代开源模型Baichuan 2,正式开源微调后的Baichuan 2-7B、Baichuan 2-13B、Baichuan 2-13B-Chat与其4bit量化版本。模型均免费可商用,已在AI模型社区魔搭ModelScope首发上架,魔搭第一时间推出了模型部署相关教程,供开发者参考并快速上手。

今年6月、7月,百川先后开源了上一代的7B和13B模型。本次开源的Baichuan 2-7B-Base和 Baichuan 2-13B-Base基于 2.6万亿高质量多语言数据进行训练,保留了上一代开源模型良好的生成与创作能力、流畅的多轮对话能力以及部署门槛较低等众多特性。

与此同时,两个模型的数学、代码、安全、逻辑推理、语义理解等能力有显著提升,Baichuan 2-13B-Base相比上一代13B模型,数学能力提升49%,代码能力提升46%,安全能力提升37%,逻辑推理能力提升25%,语义理解能力提升15%。

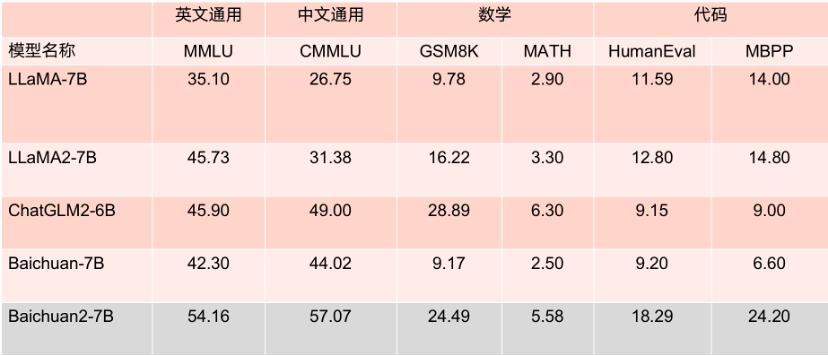

两个模型在各大评测榜单上的表现优秀,在MMLU、CMMLU、GSM8K等几大权威评估基准中以绝对优势领先LLaMA2,相比其他同等参数量大模型表现也十分亮眼。更值得一提的是,根据MMLU等多个权威英文评估基准评分 Baichuan2-7B以70亿的参数在英文主流任务上与130亿参数量的LLaMA2持平。

7B参数模型的Benchmark成绩

13B参数模型的Benchmark成绩

Baichuan2-7B和Baichuan2-13B不仅对学术研究完全开放,开发者也仅需邮件申请获得官方商用许可后,即可以免费商用。百川智能还开源了模型训练的Check Point,并宣布将发布 Baichuan 2 技术报告,详细介绍Baichuan 2 的训练细节。此举为国内首创。

作为魔搭社区的重要合作伙伴,百川智能历次开源模型都以魔搭作为国内首发平台,百川的开源模型在魔搭AI开发者群体中广受欢迎。

针对本次开源,魔搭社区基于Baichuan2-13B-Chat开发了体验接口,普通用户可以直接体验或使用模型;魔搭公众号则推出了最佳实践教程,提前跑通模型的部署、推理和微调,供开发者参考。

百川模型体验入口:

https://modelscope.cn/studios/baichuan-inc/Baichuan-13B-Chatdemo/summary

魔搭最佳实践:

https://mp.weixin.qq.com/s?__biz=MzkxNTM5NTg2OA==&mid=2247486340&idx=1&sn=c87d949cc6f84366ed394eb427a5d550&chksm=c15e8ff7f62906e1d1950a22b6c1731d2883988d828df7096f6fa9b8beecd07f47394a0986f9&token=1053714178&lang=zh_CN#rd

魔搭是国内规模最大、开发者最活跃的AI模型社区,由阿里云牵头发起。社区聚集了国内20多家头部人工智能机构贡献的1000多款优质AI模型,为开发者提供一站式的模型体验、下载、推理、调优、定制等服务。目前魔搭社区模型的累计下载量已突破6800万次。

附:魔搭社区模型下载链接

百川2-7B-预训练模型:

https://modelscope.cn/models/baichuan-inc/Baichuan2-7B-Base/summary

百川2-7B-对话模型:

https://modelscope.cn/models/baichuan-inc/Baichuan2-7B-Chat/summary

百川2-7B-对话模型-int4量化版:

https://modelscope.cn/models/baichuan-inc/Baichuan2-7B-Chat-int4/summary

百川2-13B-预训练模型:

https://modelscope.cn/models/baichuan-inc/Baichuan2-13B-Base/summary

百川2-13B-对话模型:

https://modelscope.cn/models/baichuan-inc/Baichuan2-13B-Chat/summary

百川2-13B-对话模型-4bits量化版:

https://modelscope.cn/models/baichuan-inc/Baichuan2-13B-Chat-4bits/summary

百川2-7B-训练过程模型:

https://modelscope.cn/models/baichuan-inc/Baichuan2-7B-Intermediate-Checkpoints/summary

(免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,应及时向本网站提出书面权利通知或不实情况说明,并提供身份证明、权属证明及详细侵权或不实情况证明。本网站在收到上述法律文件后,将会依法尽快联系相关文章源头核实,沟通删除相关内容或断开相关链接。 )