计算机视觉世界三大顶会之一的ICCV 2021论文接收结果出炉!本次大会收到来自全球共6236篇有效投稿,最终有1617篇突出重围被录取,录用率约为25.9%。此次ICCV 2021接收的论文分为检测、分割、跟踪、视觉定位、底层图像处理、图像视频检索、三维视觉等多个方向。本次腾讯优图实验室共有17篇论文被收录,其中Oral论文2篇,涵盖跨模态检索、分割、行人识别、神经网络、人群计数、车辆识别、物体识别、视频偏好推理、多标签识别等前沿领域。

以下为入选论文:

01 基于Wasserstein耦合图学习的跨模态检索

Wasserstein Coupled Graph Learning for Cross-Modal Retrieval

图在跨模态图像文本的理解中发挥着重要作用,因为图可以表征图像文本的内在结构,而这种结构对于跨模态相似性的度量具有很好的鲁棒性。在本文中,我们提出了一种基于Wasserstein耦合图学习的方法来处理跨模态检索任务。首先,我们分别根据两个输入的跨模态样本构建图,并通过相应的图编码器提取鲁棒特征。然后,构建一个Wasserstein耦合字典用于进一步的特征学习,其中该字典包含多组对应的图键值,并且每个键值对应一种模态。基于该耦合字典,可以通过Wasserstein图嵌入的方式将输入图转换到字典空间中实现相似性度量。所提出的Wasserstein图嵌入方法通过最优传输捕获输入图与每个对应键值之间的图相关性,从而可以很好地表征图之间的结构关系。为了进一步促进图的判别性学习,我们对耦合字典的图键值专门定义了一个基于Wasserstein度量的判别损失函数,该损失函数可以使对应的键值更加紧凑,非对应的键值更加分散。实验结果证明了我们所提出的方法的有效性。

02简笔画监督语义分割推理

Scribble-Supervised Semantic Segmentation Inference

本文提出了渐进分割推理框架(PSI)来解决简笔画监督的语义分割任务。借助于潜在的上下文依赖性,我们设计封装了上下文模式传播和语义标签传播这两条主要线索来增强并改善弱监督像素级分割结果。在上下文模式传播中,不同细粒度的上下文模式互相关联并通过图模型传递模式信息,以此来增强像素标签预测的置信推理。进一步地,依赖于已估计像素的高置信度,初始标注点的标签信息通过自适应学习策略扩散传播至图上的其他区域。上下文模式传播和语义标签传播这两条线索最终在像素级标签推理中被建模成一个闭环的更新过程。大量的实验验证了我们提出的PSI框架的有效性,同时该方法也在两个公开的简笔画分割数据集上取得了优越的性能。

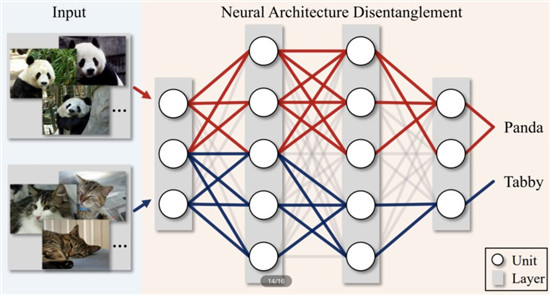

03 深度神经网络结构解耦

Architecture Disentanglement for Deep Neural Networks

(此篇论文被收录为Oral)

理解深度神经网络的内部机理对神经网络提供可信的应用十分重要。现有的研究主要聚焦于如何将具体的语义与单神经元或单层相关联,忽略了网络的整体推理过程的解释。本文提出了神经网络解耦这个概念,旨在将具体语义与解耦的子结构相关联,从而理解网络从输入到输出的整体推理过程。本文实验揭示了神经网络可以按照任务被拆解成子结构,并且最高层语义并不一定出现在神经网络最深层。最后,本文探讨了相似子结构是导致神经网络分类错误的原因之一。

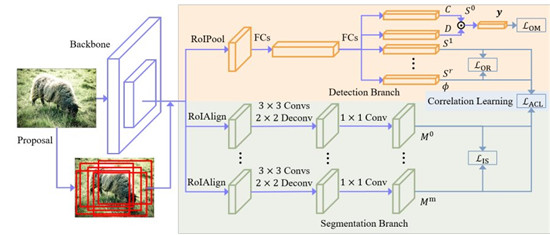

04基于并列检测分割学习的弱监督实例分割

Parallel Detection-and-Segmentation Learning for Weakly Supervised Instance Segmentation

本文从自顶而下和自底向上的实例分割方法启发,为弱监督实例分割任务提出一种统一平行检测分割的学习框架。特别地,检测模块和常见的弱监督目标检测一样,而分割模块采用自监督学习来学习类别无关的前景分割,然后再通过自训练来逐步获得特定类别的分割结果。最后,本文在多个数据集上验证了该算法的有效性。

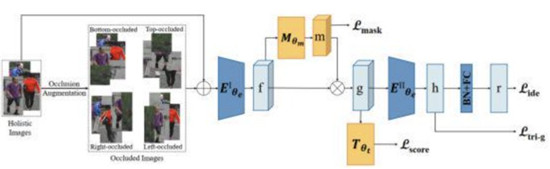

05行人重识别的遮挡感知掩码网络

Occlude Them All: Occlusion-Aware Mask Network for Person Re-identification

随着深度学习时代的到来,行人重识别(ReID)取得了显着的成就。然而,大多数方法仅解决了基于完整图片的行人重识别问题。但在真实世界的场景常常涉及被遮挡的行人,这类行人图片提供部分视觉外观,所以降低了 ReID 的准确性。一种常见的策略是通过辅助模型定位可见的身体部位,但是辅助模型的训练数据和待解决的数据存在领域偏差等,效果不佳。为了避免在遮挡ReID问题 中使用额外的有问题的模型,我们提出了 OcclusionAware Mask Network (OAMN)。该方法提出了一个基于注意力机制的的掩码模型,它需要有遮挡标签的数据来指导训练,为此,我们提出了一种新的适用于遮挡问题的数据增强方案,该方案可为任何全身数据集生成多样化且精确标记的遮挡。我们所提出的方案比现有的策略更适合包含有限种遮挡类型的现实世界情景。我们还提供了一种新颖的遮挡统一方案。上述三个模型组件使现有的注意力机制能够准确地捕捉各种遮挡情形下的身体部位。我们在多个行人重识别的benchmarks上进行了各种综合实验,证明了OAMN方法优于现有的SOTA方法。

06 夜间场景高效自监督的单目深度估计方法

Regularizing the Night-time Weirdness: Efficient Self-supervised Monocular Depth Estimation in the Dark

单目深度估计旨在从单张图像或单目视频中预测深度信息。近来一些自监督方法在KITTI和Cityscapes上获得了出色的效果。然而,在更具挑战性的黑夜场景中,由于低能见度和极端光照导致的弱纹理和帧间不一致性,这些方法往往不能得到可用的结果。为了处理这个问题,本文提出了一个新的框架:首先提出基于先验的正则化方法以学习深度信息的先验分布,避免出现异常结果;其次,提出了映射一致的图像增强模块以提升图像可见度和对比度,同时保持帧间一致性;最后,提出了基于统计的掩膜策略以去除弱纹理区域在训练中带来的干扰。实验结果证明了本文方法的有效性,同时在两个常用的黑夜数据集上获得了当前最优的效果。

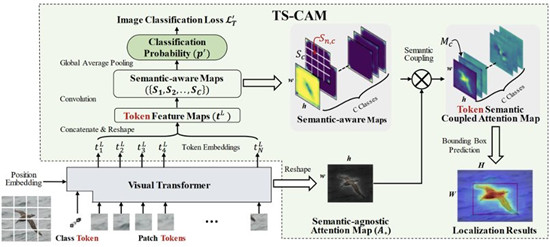

07基于耦合语义注意力的弱监督目标定位

TS-CAM: Token Semantic Coupled Attention Map for Weakly Supervised Object Localization

弱监督目标定位是指仅根据图像层面的类别标签学习目标位置的任务。基于卷积神经网络 (CNN)的分类模型往往仅会激活目标的局部判别区域,而忽略完整的目标范围,称为局部激活问题。在这篇文章中,我们认为局部激活问题是由于CNN的内在特性导致。CNN由一系列卷积操作组成,导致模型仅具有局部的感受野,无法获取长距离的特征依赖性。基于此,我们提出我们提出基于Transformer的耦合语义类别激活图(TS-CAM)方法,借助自注意力机制提取长距离特征相似性。TS-CAM 首先将图像分割为一系列子块,通过位置编码学习不同子块间全局的注意力。之后,对每个子块进行重新排列得到得到类别语义图。最后,融合模型学习的全局注意力图与类别语义图得到类别激活图。在 ILSVRC/CUB-200-2011 数据集上的实验表明,TS-CAM 的性能超过其他基于CNN-CAM结构的方法约 7.1%/27.1%,达到SOTA。

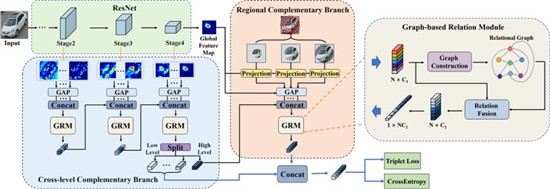

08 基于异质关系互补的车辆重识别方法

Heterogeneous Relational Complement for Vehicle Re-identification

在车辆重识别任务中,难点是从不同角度的摄像头所拍摄的图片中,准确地寻找出相同的车辆,而要有效地解决该问题,需要网络能够学习到车辆在不同角度的不变特征。为了能够获得这个鲁棒的表征,本文提出一种新型的异质关系互补网络(HRCN),该网络将特定区域特征和跨层特征作为增补特征,来增强高层表达。考虑到这些特征存在异质性,各个特征之间的分布特征以及语义信息都不尽相同,为此本文在HRCN中设计一个图关系模块,将这些异质特征嵌入到统一的特征空间。此外,本文提出一种新的评价指标Cross-camera Generalization Measure (CGM),相较CMC和mAP,CGM具备更强的位置敏感性以及更好的跨摄像头泛化惩罚。实验结果表明HRCN在VehicleID和VeRi-776数据集上均达到state-of-the-art。

09 重新思考人群中的计数和定位问题:一种完全基于点的全新框架

Rethinking Counting and Localization in Crowds: A Purely Point-Based Framework

( 此篇论文被收录为Oral)

相比仅仅估计人群中的总人数,在人群中定位每个个体更为切合后续高阶人群分析任务的实际需求。但是,已有的基于定位的解决方法依赖于某些中间表示(如密度图或者伪目标框)作为学习目标,这不光容易引入误差,而且是一种反直觉的做法。本文提出了一种完全基于点的全新框架,可同时用于人群计数和个体定位。针对基于该全新框架的方法,我们不满足于仅仅量化图像级别的绝对计数误差,因此我们提出了一种全新的度量指标即密度归一化平均精度,来提供一个更全面且更精准的性能评价方案。此外,作为该框架一个直观解法,我们给出了一个示例模型,叫做点对点网络(P2PNet)。P2PNet忽略了所有冗余步骤,直接预测一系列人头点的集合来定位图像中的人群个体,这完全与真实人工标注保持一致。通过深入分析,我们发现实现该方法的一个核心策略是为预测候选点分配最优的学习目标,并通过基于匈牙利算法的一对一匹配策略来完成了这一关键步骤。实验证明,P2PNet不光在人群计数基准上显著超越了已有SOTA方法,还实现了非常高的定位精度。

10 从异质到一致:深入研究人群计数中的计数区间划分问题

Uniformity in Heterogeneity: Diving Deep into Count Interval Partition for Crowd Counting

近期,人群计数任务中学习目标不准确的问题得到了日益的关注。受以往少数工作的启发,我们摒弃了直接预测计数值本身的思路,而是通过预测计数值所在的预设区间来解决这个问题。然而,不合适的区间划分会使得来自不同计数区间的图像块所贡献的计数误差非常不均衡,并进一步导致较差的计数精度。因此,我们提出了一个新颖的计数区间划分标准叫做均匀误差准则(UEP),该准则可以使得来自不同计数区间的计数误差贡献尽可能相等从而来最小化预测风险。进一步地,为了缓解计数值量化过程中不可避免引入的数值量化误差,我们提出了平均计数代理准则(MCP)。MCP准则为每个计数区间选取最优的计数代理值来表示所有该区间的样本在推理过程中的预测计数值,这使得图像级别的整体期望离散化误差可被忽略不计。据我们所知,本工作是第一个深入探究此类区间分类任务,并且针对其区间划分问题给出有效解决方案的。根据以上所提的可被理论证明的准则,我们设计了一个简单高效的模型,称为UEPNet,该模型在多个权威数据集上达到了SOTA的精度。

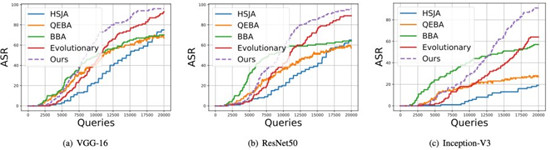

11 用于决策黑盒模型的自适应历史驱动攻击

Adaptive History-driven Attack for Decision-based Black-box Models

基于决策的黑盒攻击是指在只有目标模型的 top-1 标签可用时构造对抗样本。一种常见的做法是从一个大的扰动开始,然后用一个确定的方向和一个随机的方向迭代地减少它,同时保持它的对抗性。由于每次查询获取的信息有限和方向采样效率低下,很难在有限的查询次数内获得足够小的扰动。为了解决这个问题,我们提出了一种新的攻击方法,称为自适应历史驱动攻击(AHA),它从所有历史查询中收集信息作为当前采样的先验,以提高性能。此外,为了平衡确定性方向和随机方向,我们根据实际幅度减少与预期幅度减少的比率动态调整系数。这种策略提高了优化过程中查询的成功率,让对抗样本沿着决策边界快速移动。我们的方法还可以与子空间优化(如降维)相结合,以进一步提高效率。在 ImageNet 和 CelebA 数据集上进行的实验表明,在相同数量的查询下,我们的方法平均降低了至少 24.3% 的扰动幅度。最后,我们通过对流行的防御方法和 MEGVII Face++ 提供的APIs进行评估来证明我们方法的实际效果。

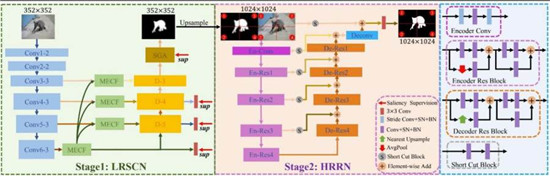

12 高质量解耦显著对象检测

Disentangled High Quality Salient Object Detection

近年来,随着数字设备的发展,越来越多的计算机视觉任务需要处理高清图像,比如视觉显著性检测任务。现有的显著性检测方法处理高清图片时,主要会面临两个问题。第一个问题是现有的方法往往无法同时精确捕捉高清图片的语义信息和边界细节。为了解决这个问题,我们将高清显著性检测任务解耦为低分-分类和高分-回归任务。在低分辨率阶段,我们提出LRSCN网络充分捕捉图片的语义信息;在高分辨率阶段,我们提出HRRN回归得到精确的边界细节。第二个问题是现有的高清显著性检测算法需要额外的高清标注数据训练网络,因而需要较大的标注代价。为了解决这个问题,我们在训练阶段使用uncertainty loss,因而不需要额外的高清训练数据训练HRRN。我们提出的方法在HRSOD-TE,DAVIS-S两个高清数据测试集,以及DUTS-TE,SOC等6个低分辨率测试数据集上都达到了SOTA的效果。

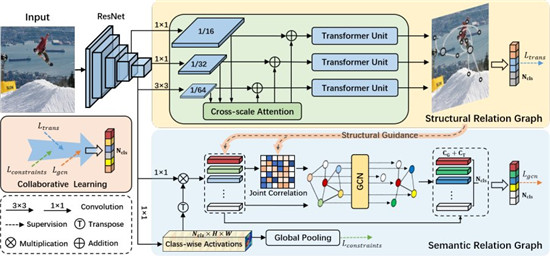

13 基于双路关系互补的多标签识别方法

Transformer-based Dual Relation Graph for Multi-label Image Recognition

多标签识别的主要目标是同时识别一幅图像中的多个对象。现有的大多数工作主要通过学习标签共现依赖关系从而增强特征的语义表达,而忽略了图像中多个物体间的空间依赖关系。对此,本文提出一种基于Transformer的双路互补关系学习框架来联合学习空间依赖与共现依赖。针对空间依赖,该方法提出跨尺度Transformer建模长距离空间上下文关联;针对共现依赖,该方法提出类别感知约束和空间关联引导,基于图神经网络联合建模动态语义关联,最后联合这两种互补关系进行协同学习得到鲁棒的多标签预测结果。实验结果表明,该方法在经典多标签识别数据集MS-COCO 和VOC 2007上均超过SOTA。

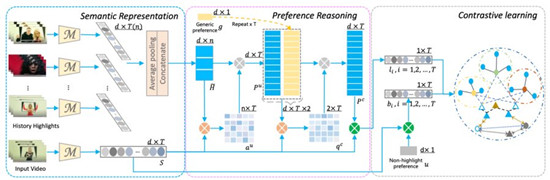

14 基于偏好推理的个性化精彩视频检测

PR-Net: Preference Reasoning for Personalized Video Highlight Detection

个性化精彩视频检测旨在根据用户的喜好将长视频缩短为有趣的时刻,这最近也引起了社区的关注。目前的方法将用户的历史作为整体信息来预测用户的偏好,但忽略了用户兴趣的内在多样性,导致偏好表示模糊和无法解释的预测。在本文中,我们提出了一个简单而有效的偏好推理框架(PR-Net),显式地将不同的兴趣考虑在内,以进行具有可行解释的帧级精彩预测。具体来说,对于每个输入帧,我们通过基于注意力机制的历史精彩片段融合来生成输入相关的用户偏好。此外,为了防止用户历史信息不全等问题,我们将由用户特定的偏好和学习得到的通用偏好融合成了综合的偏好特征,从而实现了自适应地支持通用精彩视频检测。最后,我们通过计算查询帧与该用户的综合偏好及非精彩偏好特征之间的语义相似度来预测其是否属于精彩帧的程度。此外,为了缓解由于标注不完整造成的歧义,我们提出了一种新的双向对比损失,以确保嵌入空间的紧凑性和可微性。通过这种方式,我们的方法显着优于最先进的方法,平均准确度精度相对提高了 12%。

15从学习中知道哪里可见:针对遮挡行人重识别的一种可见度感知方法

Learning to Know Where to See: A Visibility-Aware Approach for Occluded Person Re-identification

行人重识别在近年来已经取得了明显的进步。然而,遮挡现象对最近的行人重识别方法依然是个常见且具有挑战性的任务。目前一些主流方法利用额外信息(比如,人体姿态信息)来判断人体可见部位,从而缓解遮挡问题。虽然这些方法取得明显的进步,但是他们严重依赖于细粒度的额外信息,对额外信息中存在的估计错误敏感。在本文中,我们证实了如果额外信息变得稀疏或者有噪声时,现存的方法性能是会出现下降的。因此,我们提出了一种简单但有效的方法,该方法对稀疏和有噪声的姿态信息是鲁棒的。我们将姿态信息离散化为人体部分的可见度标签,这可以降低遮挡区域的影响。我们在实验中证明了我们的方法能够更有效和鲁棒地利用姿态信息。此外,我们的方法能够很容易地嵌入到大多数行人重识别方法中。相关的实验证明了我们的算法达到了目前的领先水平。

16 Ask&Confirm: 不完整描述下跨模态检索的主动细节丰富

Ask&Confirm: Active Detail Enriching for Cross-Modal Retrieval with Partial Query

近年来,基于文本的图像检索取得了长足的进步。然而,现有方法的性能在现实生活中会受到影响,因为用户可能会提供对图像的不完整描述,这通常会导致结果充满了符合不完整描述的误报。在这项工作中,我们引入了部分查询问题并广泛分析了它对基于文本的图像检索的影响。以前的交互式方法通过被动地接收用户的反馈来迭代地补充不完整的查询来解决这个问题,这既耗时又需要大量的用户努力。相反,我们提出了一种新颖的检索框架,该框架以询问和确认的方式进行交互过程,其中 AI 主动搜索当前查询中缺少的判别细节,而用户只需要确认 AI 的提议。具体来说,我们提出了一种基于对象的交互,使交互检索更加用户友好,并提出了一种基于强化学习的策略来搜索有区别的对象。此外,由于难以获得人机对话数据,全监督训练通常是不可行的,因此我们提出了一种弱监督训练策略,除了文本图像数据集之外,不需要人工标注的对话。实验表明,我们的框架显着提高了基于文本的图像检索的性能。

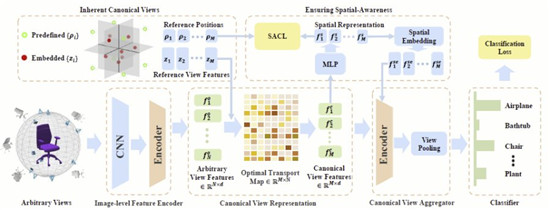

17为任意视角下的3D物体识别学习具有空间感知能力的典范视角表征

Learning Spatially-Aware Canonical View Representation for 3D Shape Recognition with Arbitrary Views

为使多视角3D物体识别更切合实际场景,这篇工作专注于任意视角下的物体识别,即视角位置与个数任意给定的情况;为解决任意视角带来的新挑战,我们提出一种具有空间感知能力的典范视角表征;我们首先将来自任意视角的图像特征使用最优传输与一组可学的参考视角特征对齐,由此得到一组固定数量的典范视角特征;随后我们将这些对齐的典范视角特征进行聚合,得到一个鲁棒的3D物体表征用于识别;我们在此提出一种空间感知损失,约束典范视角特征能被离散地嵌入于欧式空间的各个象限;在ModelNet40、ScanObjectNN与RGBD数据集中的实验结果表明,我们的方法不仅在传统的固定视角情况下性能优秀,而且在更有挑战的任意视角情况下相比其他方法有显著的性能提升。

(免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,应及时向本网站提出书面权利通知或不实情况说明,并提供身份证明、权属证明及详细侵权或不实情况证明。本网站在收到上述法律文件后,将会依法尽快联系相关文章源头核实,沟通删除相关内容或断开相关链接。 )