近日,牛津大学官方发布一则最新动态,牛津大学人工智能伦理研究所(Institute for Ethics in AI)委任了由 7 位哲学家组成的首个学术研究团队。

该团队将在 10 月份迎来首任所长,来自伦敦国王学院 Yeoh Tiong Lay Centre for Politics, Philosophy and Law 的主任 John Tasioulas 教授。

图片来源:牛津大学官网

随着人工智能技术飞速发展,人脸识别、语音助理、医学诊疗机器助手等新型应用对人们的生产生活带来了极大地变革,同时也催生了人工智能的伦理学和跨人类主义的伦理学问题。

AI 伦理上升为国家战略

八月底,SpaceX 、特斯拉等公司的创始人埃隆?马斯克(Elon Musk),为自己旗下的脑机接口公司 Neuralink 举行发布会,向公众展示了将 Neuralink 芯片植入小猪颅内,并实时读取猪脑信息。

该消息一出,便引来一些网友的担心,从伦理道德的角度来看,这类技术的发展会不会给人类带来意想不到的危机?

今年上半年,美国五角大楼已正式公布人工智能五大伦理原则,即负责、公平、可追踪、可靠和可控。无论作战还是非作战人工智能系统,均须遵守上述原则,否则美国防部将不予部署。

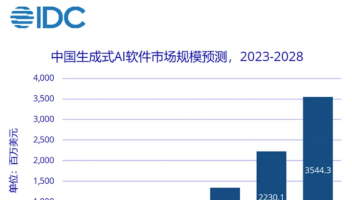

8 月 5 日,中国国家标准化管理委员会、中央网信办、国家发展改革委、科技部、工业和信息化部发布关于印发《国家新一代人工智能标准体系建设指南》的通知。

人工智能标准体系框架图

《指南》将人工智能标准体系结构分为 “A 基础共性”、“B 支撑技术与产品”、“C 基础软硬件平台”、“D 关键通用技术”、“E 关键领域技术”、“F 产品与服务”、“G 行业应用”、“H 安全 / 伦理” 八个部分,其中 “H 安全 / 伦理” 标准贯穿于其他部分,立足于规范人工智能服务冲击传统道德伦理和法律秩序而产生的要求建立相关标准,为人工智能建立合规体系。

牛津AI伦理研究所团队阵容

2019 年 6 月,美国黑石集团联合创始人、全球主席兼首席执行官苏世民(Stephen A. Schwarzman)向牛津大学捐赠 1.5 亿英镑,支持牛津大学成立了 AI 伦理研究所。

该研究所下设在苏世民人文中心内,隶属于哲学系,致力于研究解决人工智能带来的重大伦理挑战,研究范围涉及从人脸识别到选民分析,从脑机接口到武器化无人机,以及正在进行的关于人工智能将如何在全球范围内影响就业的相关讨论。

据报道,在牛津大学发展史上,苏世民人文中心将首次汇集牛津大学的人文学科研究实力,以多学科融合的研究背景,让人工智能伦理道德领域的研究从中受益。

刚组建的首个学术研究团队,最初将由以下 7 位哲学家组成:

主任:John Tasioulas 教授,他将从伦敦国王学院加入该团队,担任主任一职,他是该学院政治、哲学和法律方面的首任主席(inaugural Chair),也是 Yeoh Tiong Lay 政治、哲学和法律中心(Yeoh Tiong Lay Centre for Politics, Philosophy & Law)的主任。他曾在牛津大学任教道德与法律哲学 12 年,曾在芝加哥、哈佛、墨尔本担任访问学者,并担任过世界银行人权顾问。

哲学副教授:Carissa Véliz 博士,曾任牛津大学 Uehiro 实践伦理中心和 Wellcome 伦理与人文中心的研究员,并将成为赫特福德学院的辅导研究员。

哲学副教授:Milo Phillips-Brown 博士,他将从麻省理工学院加入该团队,他是伦理学与技术领域的杰出学者,还是 Jain Family Institute 数字道德与治理的高级研究员,并将成为耶稣学院的导师研究员。

Carina Prunkl 博士和 Ted Lechterman 博士,这两位博士将以博士后研究学者的身份加入团队,他们分别来自牛津大学人类未来研究所和柏林赫蒂治理学院。

另外,团队还有两名博士生,将在下一学年加入。

AI 伦理研究已迫在眉睫

任职前,Tasioulas 教授围绕一些问题,谈了他对研究所的愿景。

当被问到 “人工智能伦理学为什么这么重要”,Tasioulas 教授表示:“人工智能将继续对人们生活中的许多方面产生变革性的影响,从医学到法律再到我们如何实现民主,它提出了深刻的伦理问题,其中涉及隐私、歧视以及自动决策在充实的人类生活中的地位等问题,社会生活中的每一个个体都不可避免地要面对这些问题。我不希望人工智能伦理学被视为一个狭隘的专业,相反,对于那些认真关注人类面临重大挑战的人,AI 伦理学更应该成为他们必须解决的问题。如果人工智能想要推动人类的繁荣发展和社会的公平正义,AI 伦理学绝对不是可选项或奢侈品,而是必要的。”

“鉴于人工智能将一直存在,所以我们必须提高围绕人工智能伦理的辩论水平,并反馈给公民和立法者,以促进更加广泛的民主进程。人工智能领域的法规和政策对于民主决策至关重要,但致力于 AI 伦理问题研究的专家所持的论点和见解,会提高审议过程的质量。”Tasioulas 教授说。

当谈到研究所的预期目标时,Tasioulas 教授说:“我的目标是让研究所为人工智能伦理学的探讨带来最高标准的学术严谨性,研究所深深扎根于哲学,同时还将借鉴其他学科,如文学、医学、历史、音乐、法律和计算机科学。这是在这一领域在弥合科学与人文科学之间鸿沟的一次激进尝试,而牛津大学在这方面有着得天独厚的优势。”

Tasioulas 教授表示,这次 COVID-19 大流行恰恰说明了为什么哲学必须在民主决策中发挥关键作用,新冠大流行表明,仅仅 “遵循科学” 是永远不够的。总要做出价值判断,比如风险在社会中的分配,以及繁荣与健康之间的权衡。

当被问及对于整个 AI 伦理学领域的研究目标的时候,Tasioulas 教授说:“生物伦理学就是一个很好的例子,它说明了伦理学在解决社会面临的重大问题上的作用,但它也是一个警示性的故事。生物伦理学有真正杰出的人物,他们有很强的哲学背景,为了推动这门学科的发展,他们汲取了更深的道德和政治哲学方面的专业知识。但目前,你听到的很多关于人工智能伦理学的内容都缺乏这种深度,太多的是公司治理语言的翻版,甚至只是一些声音和流行语。而一个可持续的人工智能伦理学发展需要立足于更深更广的东西,这必须包括哲学和更普遍的人文科学。牛津大学的人工智能伦理学研究所恰恰可以起到这种作用,将知识的严谨性和清晰度引导到公共辩论和决策领域。”

“科学可以告诉我们行为的后果,但它并不能告诉我们应该追求哪些目标,也不能告诉我们为了实现这些目标,什么样的牺牲是合理的。我们想要让人工智能成为用技术解决社会挑战的一部分,就这件事而言,我们不可避免地也要解决伦理问题。人工智能伦理学是一种使所涉及的价值判断变得更加清晰的方法,也是一种支持更严谨、更包容辩论的方式。” Tasioulas 教授表示。

应对重大的全球性挑战

研究所指导小组主席 Sir Nigel Shadbolt 教授领导了最初的提议,他表示:“我很高兴欢迎这群令人敬畏的学者加入研究所的教师团队,我们的愿景是建立一个能够为人工智能伦理学奠定基础的研究所,从而为我们对这项非凡技术的使用提供帮助。这个伟大的团队和他们所进行的研究,将有助于确保人工智能技术对于人类的经验起到增强的作用,而非削弱。”

牛津大学副校长 Louise Richardson 教授说:“这是牛津大学一个重要的里程碑,因为这个优秀的领导团队将加速推进我们团结人文学者和科学家的工作,以应对重大的全球性挑战。”

牛津大学人文科学系主任 Karen O'Brien 教授说:“我们很高兴能任命 John Tasioulas 这样的人才担任研究所的首任所长,John 是一位杰出的道德和法律哲学家,他对研究所和整个人工智能伦理学领域的发展愿景给我们留下了深刻印象。他在伦敦国王学院成功建立了研究中心,在这方面拥有宝贵的经验。”

“几乎在一夜之间,人工智能伦理学研究所已经成为人工智能伦理学领域的领先研究中心。该研究所拥有了一支由 7 位杰出研究人员组成的核心学术团队,研究所可以开展新的研究,并举办更多的活动,将学术专家、技术人员、政府领导者以及广大公众聚集一堂。” Karen 教授表示。

苏世民在评论这一任命时,补充道:“人工智能有可能成为一股善的力量,但如果不以道德和负责任的方式应用它,也会带来巨大的风险。牛津大学在探索这些考虑因素方面具有独特的优势,就像它在过去的千年里帮助解决社会上面临的最紧迫的伦理问题一样,我很期待看到 John 和研究所即将作出的贡献。”

该研究所还将把人工智能伦理学应用于应对 COVID-19 大流行病等挑战。今年早些时候,该研究所指导小组的 Michael Parker 教授向英国政府提供了关于联系追踪应用程序开发的伦理学基础方面的建议。他还是政府紧急情况科学咨询小组(SAGE)的成员,并参与撰写了有关技术如何减缓病毒传播速度的研究报告。

Véliz 博士说:“作为研究所,我们的目标是进行极其严谨的研究,该研究完全独立于大科技(Big Tech)的压力,并为确保人工智能只以符合最高道德标准的方式构建和实施做出贡献。”

(免责声明:本网站内容主要来自原创、合作伙伴供稿和第三方自媒体作者投稿,凡在本网站出现的信息,均仅供参考。本网站将尽力确保所提供信息的准确性及可靠性,但不保证有关资料的准确性及可靠性,读者在使用前请进一步核实,并对任何自主决定的行为负责。本网站对有关资料所引致的错误、不确或遗漏,概不负任何法律责任。

任何单位或个人认为本网站中的网页或链接内容可能涉嫌侵犯其知识产权或存在不实内容时,应及时向本网站提出书面权利通知或不实情况说明,并提供身份证明、权属证明及详细侵权或不实情况证明。本网站在收到上述法律文件后,将会依法尽快联系相关文章源头核实,沟通删除相关内容或断开相关链接。 )